Bonjour à tous,

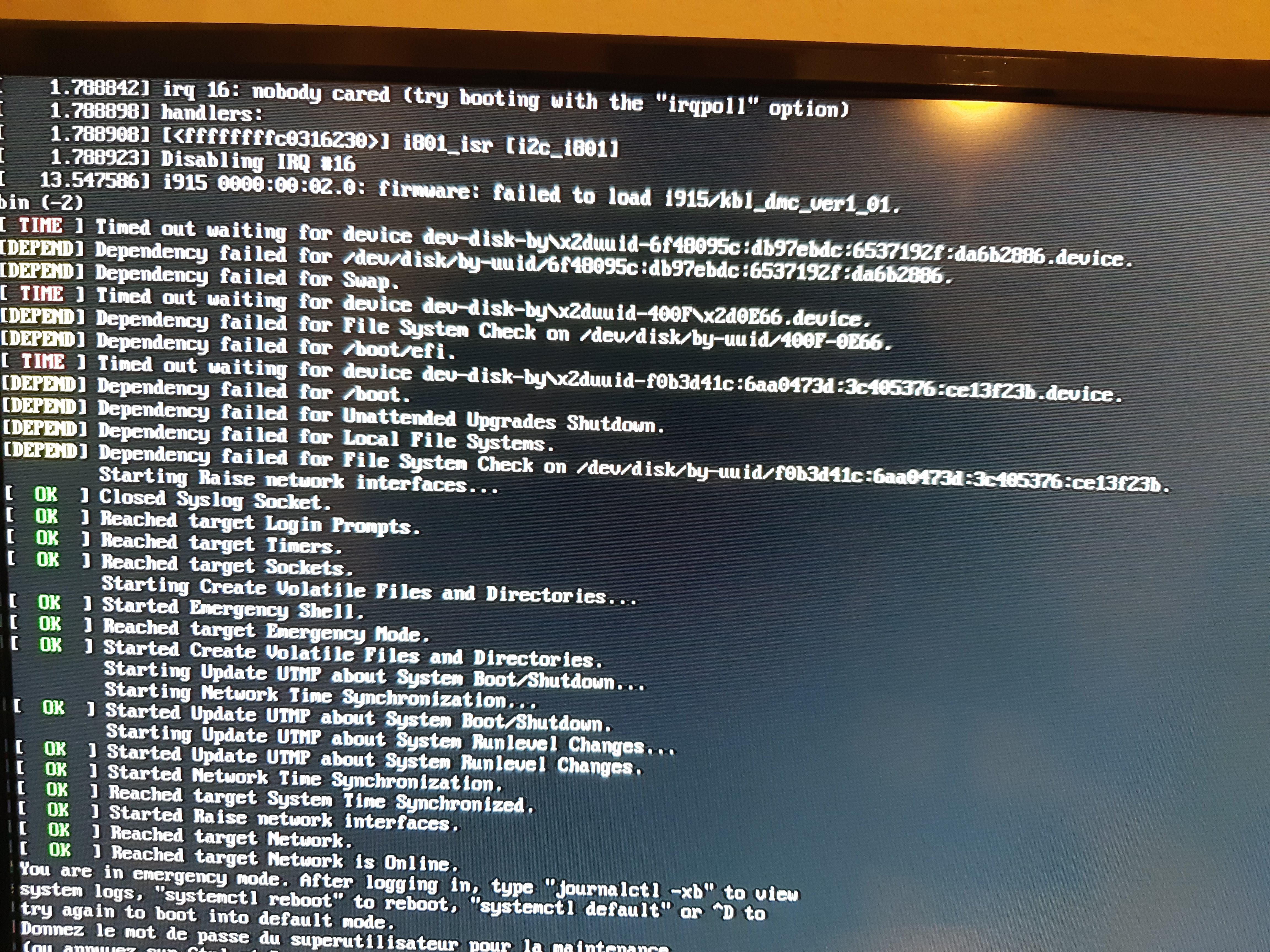

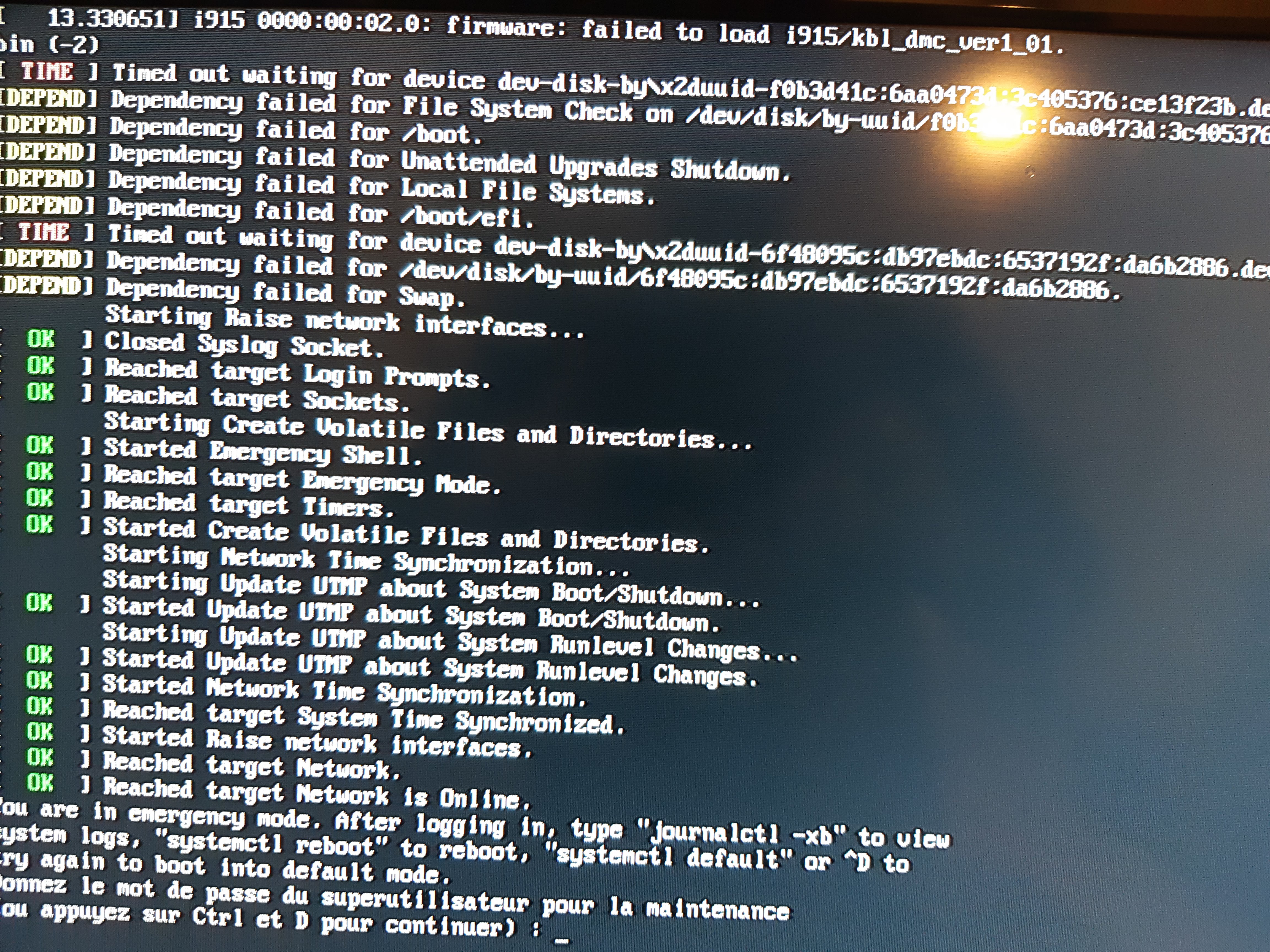

J’ai subis de grosses lenteurs sur une machine Debian 9 et après quelques tests il s’avère qu’un des 2 HDD en RAID 1 est défectueux (les commandes smartctl -H /dev/sda indiquent que le disque a ré-alloué +1700 secteurs)

J’ai donc désactivé le disque via les commandes mdadm avec --fail --remove

Toutefois, c’est le disque /dev/sda qui contient les partitions “Système de fichiers Linux”, “Système EFI” et la partition SWAP

Le RAID 1 (/dev/md0) est construit avec /dev/sda4 et /dev/sdb1

J’en déduis donc qu’il faut que sur /dev/sdb je dois créer 3 nouvelles partitions pour accueillir les 3 partitions (système fichiers, système efi et SWAP) ?

Cependant, la partition /dev/sdb1 occupe tout l’espace du HDD, il faut donc que je réduise sa taille (ou celle de /dev/md0 ?) afin de pouvoir créer ces 3 nouvelles partitions ?

J’utilise les tutos suivants :

1 - Pour retailler la taille des partitions : https://www.howtoforge.com/how-to-resize-raid-partitions-shrink-and-grow-software-raid

2 - Pour déplacer les 3 partitions vers le disque qui fonctionne : https://www.tecmint.com/clone-linux-partitions/

3 - Pour remplacer le disque défectueux par un autre : linux raid replace failed harddisk

Si j’écris ce topic c’est parce que j’aimerais que aillant + de connaissances que moi puisse m’indiquer si mon raisonnement est bon et si ce que je projette de faire est OK. Dans le cas contraire merci de m’indiquer ce qui ne va pas s’il vous plaît.

S’il vous faut des éléments supplémentaires (résultats de commandes ou autre) ne pas hésiter à me demander

Je vous remercie par avance pour votre aide  !

!

Eulafe

?

?